-

[논문리뷰] Probabilistic Topic Models(2012)논문 리뷰 2022. 5. 23. 00:00728x90

Probabilistic Topic Models(2012)

Blei, D. M. (2012). Probabilistic topic models. Communications of the ACM , 55(4), 77-84.

- 본 글은 노션에 더 자세히 정리하였다.

Probabilistic Topic Models(2012)

Blei, D. M. (2012). Probabilistic topic models. Communications of the ACM , 55(4), 77-84.

sunny-numeric-20a.notion.site

Probabilistic Topic models의 키포인트

- LDA는 토픽을 발견하는 기술로 생성적 확률 모델군에 속함.

- 구조화되지 않은 대규모 문서 컬렉션에 퍼져 있는 메인 주제를 발견하기 위한 알고리즘

- 토픽 모델은 발견된 테마에 따라 컬렉션을 구성할 수 있다.

- 토픽 모델링 알고리즘은 방대한 문서 컬렉션에 적용할 수 있으며, Web API에서 찾을 수 있는 스트리밍 컬렉션을 분석할 수 있다.

- 다양한 종류의 데이터에 적용할 수 있다. 다른 응용 프로그램 중에서 유전자 데이터, 이미지 및 소셜 네트워크에서 패턴을 찾는 데도 사용됨.

LDA(Latent Dirichlet Allocation)의 기본 아이디어

- LDA는 문서가 여러 토픽을 표시한다는 가정으로 시작한다.

- (토픽이 구별될 필요가 없으며, 여러 토픽에서 단어가 발생할 수 있다는 뜻)

- 토픽은 고정 어휘에 대한 분포로 정의하고, 문서보다 토픽이 먼저 생성된다고 가정한다.

(사람들이 글을 쓸 때, 문헌에 어떤 주제가 들어갈 지 대략 생각하고, 주제를 선정해 주제에 포함될 단어를 선정하고 그 단어를 문헌에 추가한다고 가정)

- 토픽 = 주어진 용어 집합이 발생할 확률

2단계 프로세스를 통해 단어 생성

- 주제에 대한 분포에서 무작위로 주제 선택

- 어휘에 대한 분포에서 무작위로 단어 선택

- 연속 혼합 분포가 말뭉치에 걸쳐 발생하고, 말뭉치에 있는 각 문서 내의 다른 혼합체에서도 나타나 토픽을 편리하게 발견할 수 있는 방법

LDA 모형

N : 문헌에 속한 단어의 개수

D : 문헌의 개수

K : 주제의 개수

θ : 문헌의 주제 분포(디리클레 분포를 따름)

Z : 해당 단어가 속한 주제의 번호

W : 관측할 수 있는 단어

- 초기 하이퍼파라메터 α 값은 문헌의 주제분포가 얼마나 밀집되어있는지 성긴지를 조절하는역할

- 하이퍼 파라미터 β는 주제별로 단어들이 얼마나 모여있는지 그렇지 않은지를 결정

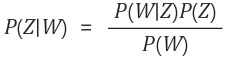

- 베이즈 정리로 정리하면 P(Z|W)를 최대로 하는 Z값을 찾는 것이 LDA의 목표임

느낀점

영문으로 된 논문을 읽는 다는 것은… 너무 너무 어렵다. 한글로 쉽게 설명해주는 빛 같은 존재가 없었다면 이해하기 어려웠을 것이다. 논문을 이해하기 위해서 다양한 “한국어” 참고자료들이 필요하고, 결국 직접 해보지 않으면 안되겠다는 생각이 들어 곧 LDA를 한번 해볼 예정…

⚠️ LDA 이해에 도움을 준 참고 자료

- 파이썬으로 배우는 응용 텍스트 분석, 벤자민 벵포트 외 2인, 박진수 옮김, 제이펍, 2019.

- [잠재 디리클레 할당 파헤치기1~3] https://bab2min.tistory.com/567

[잠재 디리클레 할당 파헤치기] 1. 베이즈 추론

작년에 토픽 모델링이라는 개념을 접하고 깜짝 놀랐어요. 그냥 적당한 크기의 문헌들을 넣어주면 거기에서 적절하게 컴퓨터가 연관된 단어들을 묶어서 주제 분포를 만들어주고, 문헌별로 주제

bab2min.tistory.com

728x90'논문 리뷰' 카테고리의 다른 글

[논문리뷰] 딥러닝 중심의 자연어 처리 기술 현황 분석(2021) (0) 2022.09.25 [논문리뷰] Calibrating Probability with Undersampling for Unbalanced Classification(2015) (0) 2022.08.14 [논문리뷰] Distributed Representations of Words and Phrasesand their Compositionality(2015) (0) 2022.07.03 [논문 리뷰] TextRank: Bringing Order into Texts(2004) (0) 2022.03.28 논문리뷰! INTRO (0) 2022.03.15